Seguindo a tendência da internet daquele momento, uma deputada do Rio de Janeiro pediu para a inteligência artificial (IA) produzir um desenho no estilo de animação do estúdio Pixar. No comando, solicitou a imagem de uma mulher negra, com cabelos afro e roupas de estampa africana, em um cenário de favela. Como resultado, contudo, a IA gerou a imagem de uma mulher negra com uma arma de fogo na mão. O fato virou notícia na época e ampliou a discussão sobre o chamado racismo algorítmico.

O episódio ocorreu com a deputada Renata Souza, em outubro de 2023, e a parlamentar utilizou as mídias sociais para expor o ocorrido. Diferentemente de uma acusação de racismo praticada por uma outra pessoa, ação que é crime no Brasil, a denúncia se dirigia a um conjunto matemático de instruções utilizado por computadores, ou seja, ao algoritmo, elemento considerado por muitos como neutro. Muitos estudiosos, porém, têm provado que essa ideia de neutralidade não passaria de uma grande farsa.

“As plataformas não são espaços neutros na medida em que elas operam a partir de sistemas algorítmicos que filtram e hierarquizam conteúdos, priorizam algumas vozes e silenciam outras”, afirma o professor Júlio Araújo, do Departamento de Letras Vernáculas da Universidade Federal do Ceará (UFC), que tem demonstrado em suas pesquisas como os algoritmos reforçam o racismo na sociedade.

Ele destaca que algoritmos são produzidos por seres humanos, pessoas que compartilham de todos os tipos de valores. Muitos desses programadores, acrescenta, defendem racismo, sexismo e noções falsas de meritocracia. “Os algoritmos amplificam discursos de ódio, silenciam vozes dissidentes e validam o padrão da branquitude como norma”, complementa.

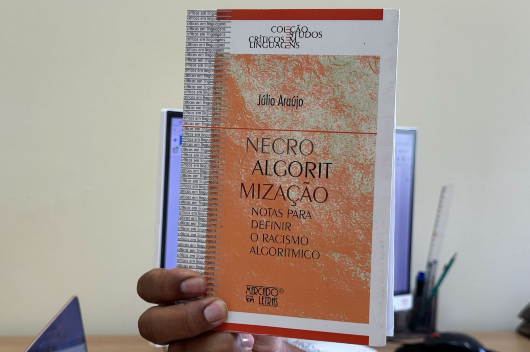

O professor nomina essa ação realizada por algoritmos de necroalgoritmização, termo que ele esclarece no livro lançado em agosto deste ano, intitulado “Necroalgoritmização: notas para definir o racismo algorítmico”. “É a organização algorítmica da exclusão, do silenciamento e, muitas vezes, da morte social”, elucida.

Como os algoritmos se tornaram mediadores centrais da linguagem, da circulação de sentidos e da visibilidade dos discursos na era digital, estudá-los no campo da Linguística, defende Araújo, coloca-se como um esforço essencial. “Defendo que o algoritmo é um texto. Isso significa que ele não é apenas um conjunto de comandos técnicos, mas uma forma de linguagem que organiza sentidos, produz efeitos discursivos e participa ativamente da vida social”, conceitua.

Apesar de escritos em linguagem de programação, os algoritmos carregam ideologias, interesses econômicos e relações de poder. “Não existe texto neutro. Todo texto é produzido em condições históricas, sociais e culturais específicas, carrega intenções, escolhas e silenciamentos”, destaca o professor, que coordena, na UFC, o projeto Inteligência Artificial e Racismo Algorítmico (Iara), financiado pelo Conselho Nacional de Desenvolvimento Científico e Tecnológico (CNPq).

De acordo com ele, quando um sistema de IA prioriza determinados rostos, palavras ou narrativas e silencia outros, ele não está apenas processando dados: “ele está atuando discursivamente, reescrevendo desigualdades históricas em código”. Essas operações, reforça, não são falhas técnicas acidentais, mas operações discursivas e computacionais que institucionalizam desigualdades.

COMO O ALGORITMO OPERA

São diversos os mecanismos pelos quais os algoritmos atuam de forma a perpetuar e amplificar o racismo. Um deles é por meio de sua base de dados, a qual o pesquisador caracteriza como enviesada, por tratar corpos negros como exceção e não como referência. Nestas bases, as categorias raciais e representações estigmatizadas já estão inscritas. Ele denuncia que os algoritmos são treinados com dados que carregam marcas históricas de exclusão racial, como a associação da pessoa negra à pobreza e à violência.

Desta forma, modelos de crédito automatizado, por exemplo, associam território, raça e pobreza a “risco financeiro”; sistemas de recrutamento excluem perfis que fogem do padrão hegemônico (homem branco e de classe média); e ranqueamentos e recomendações priorizam conteúdos que geram engajamento, incluindo o racista e o misógino. As mulheres negras, inclusive, são o epicentro desse racismo algorítmico, afirma o professor, por estarem na encruzilhada de múltiplas opressões: raciais, de gênero e de classe.

Ele destaca como as plataformas lucram com o preconceito: “Conteúdos que geram choque, indignação, conflito ou ódio, inclusive conteúdos racistas, são altamente rentáveis porque prolongam o tempo de permanência e aumentam a coleta de dados, o que amplia o lucro publicitário das plataformas”, explica.

Uma outra forma de atuação é pela moderação automatizada, ou seja, pela atividade de monitoramento e filtragem de conteúdos feita por inteligência artificial. Araújo afirma que esse tipo de moderação é falho, pois remove denúncias, deixa passar ofensas e deslegitima reivindicações, invisibilizando conteúdos antirracistas ao interpretá-los como “violação de diretrizes”.

Os algorítmos de reconhecimento facial também são apontados como um forte elemento de prática de racismo, pois são bem menos precisos com rostos de pessoas negras do que com brancas. “Há casos emblemáticos, como o de Robert Williams, homem negro preso injustamente em Detroit (EUA) após um sistema de reconhecimento facial errar sua identificação. Ou o de Nijeer Parks, também homem negro, detido por ‘semelhança algorítmica’ mesmo com provas físicas que demonstravam sua inocência. No Reino Unido, motoristas negros de aplicativos foram bloqueados por falhas em sistemas de autenticação facial, perdendo acesso a suas fontes de renda”, cita.

No Brasil não é diferente. Um levantamento da Rede de Observatórios da Segurança revelou que 90,5% das pessoas presas no país com base em reconhecimento facial eram negras.

ATUAÇÃO INVISÍVEL

O conceito de racismo algorítmico já vem sendo estudado por pesquisadores de todo o mundo. Entretanto, ele não deve ser visto como uma “atualização” do racismo estrutural, e sim como um novo regime que opera com lógicas próprias.

“Enquanto o racismo estrutural se manifesta por práticas visíveis, institucionalizadas e, em certa medida, reconhecíveis, o racismo algorítmico atua de modo silencioso, técnico e muitas vezes invisível, o que lhe confere uma potência política e simbólica singular”, esclarece. Por esta razão, o pesquisador usa o conceito de microagressões algorítmicas. O prefixo “micro” é aplicado porque tais agressões não são, na maioria das vezes, brutas e violentas fisicamente. Mas são paralisantes para o sujeito agredido.

Essa forma de racismo é mais difícil de contestar, segundo o pesquisador, por conta de pelo menos quatro razões centrais. “Primeiro, pela opacidade técnica, já que os algoritmos são caixas-pretas, protegidas por segredos industriais e complexidade computacional, o que dificulta saber onde, quando e como a discriminação acontece”, pontua.

O segundo é a narrativa de neutralidade tecnológica. Por serem ferramentas matemáticas, os algoritmos fazem com que decisões discriminatórias sejam vistas como “técnicas” e não ideológicas. “Terceiro, pela escala e velocidade de operação, que pulverizam a violência racial em milhões de microdecisões diárias, tornando seus efeitos difusos e menos localizáveis”, continua.

A última razão, informa, é o deslocamento da responsabilidade: “quando a violência é cometida por um indivíduo ou instituição, há caminhos para responsabilização. Mas quando ela é automatizada, quem responde? O programador? A empresa? O modelo? Essa indefinição enfraquece as possibilidades de enfrentamento jurídico, político e discursivo”, analisa.

NECESSIDADE DE REGULAÇÃO

Para o pesquisador, não adianta apenas reconhecer que há viés nos algoritmos. É necessário entender que a necroalgoritmização é formada por dispositivos discursivos e políticos que operam sem controle social e em busca de lucro. Ao operarem realimentando desigualdades históricas, os algoritmos cristalizam o racismo na lógica operacional das máquinas.

Segundo o professor, a resposta da sociedade a esse fenômeno ainda é superficial e reativa, surgindo apenas após casos graves. Para ele, é preciso uma ação preventiva: “com regulação robusta, transparência obrigatória, participação social nas auditorias e inclusão de perspectivas antirracistas no desenho dessas tecnologias”.

“Enquanto a sociedade não tratar o racismo algorítmico como um problema estrutural de direitos humanos, e não como um “viés corrigível”, continuaremos naturalizando prisões indevidas, silenciamentos e exclusões como se fossem “efeitos colaterais inevitáveis” do progresso tecnológico”, conclui.

Fonte: Júlio Araújo, professor do Departamento de Letras Vernáculas da UFC – e-mail: araujo@ufc.br

USE NOSSAS MATÉRIAS

A reprodução dos textos da Agência UFC é permitida, com atribuição. Caso o texto seja reproduzido na íntegra, ele deve ser assinado com o nome do repórter seguido do identificador “da Agência UFC”. Caso o texto passe por cortes ou ajustes no processo de edição, deve-se publicar apenas “da Agência UFC”, ou forma semelhante, de acordo com os padrões adotados pelo veículo.

Saiba mais sobre como usar as matérias da Agência UFC